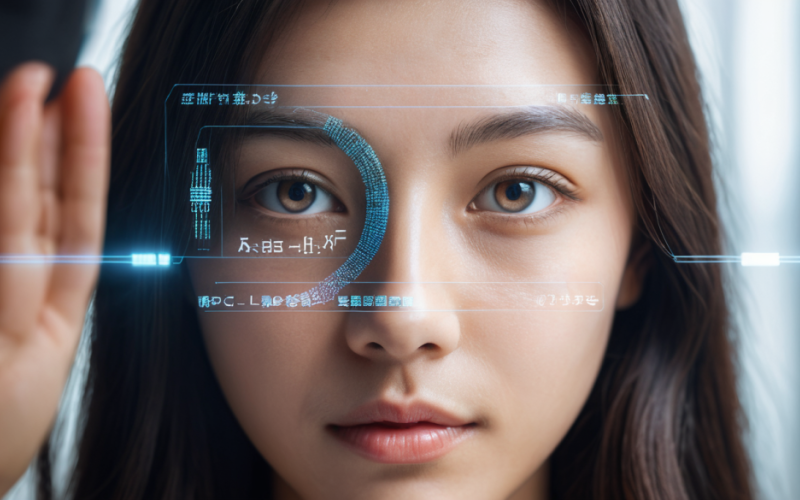

وقتی هوش مصنوعی از روی چهره حقوق افراد را حدس میزند

پژوهشی تازه که بر پایه تحلیل هزاران تصویر پروفایل حرفهای انجام شده، بحثهای گستردهای درباره مرز میان علم و شبهعلم، تبعیض الگوریتمی و آینده فرآیندهای استخدام به راه انداخته است.

به گزارش سیتنا، ماجرا از جایی آغاز شد که گروهی از پژوهشگران آمریکایی حدود ۱۰۰ هزار تصویر پرتره را عمدتاً از پروفایلهای لینکدین فارغالتحصیلان MBA در اختیار یک الگوریتم یادگیری ماشین قرار دادند. هدف این بود که بررسی شود آیا سیستم میتواند فراتر از ظاهر، نشانههایی از ویژگیهای شخصیتی مانند صداقت، وظیفهشناسی، برونگرایی، سازگاری و حتی احتمال موفقیت مالی را استخراج کند یا خیر.

نتایج ادعایی این پروژه، بسیاری را شگفتزده کرد. پژوهشگران مدعی شدند مدلهای هوش مصنوعی قادرند از روی تصاویر استاندارد، الگوهایی مرتبط با برخی شاخصهای شخصیتی را شناسایی کنند. گزارشها همچنین حاکی از آن است که برخی شرکتهای بزرگ مالی و فناوری، بهطور آزمایشی از این ابزارها در کنار رزومه و مصاحبههای سنتی استفاده کردهاند.

مرز باریک علم و شبهعلم

با وجود جذابیت فناورانه، این رویکرد یادآور نظریههای قدیمی «چهرهخوانی» است؛ دیدگاهی که قرنها پیش برای نسبت دادن ویژگیهای اخلاقی و اجتماعی به ظاهر افراد به کار میرفت و بعدها به دلیل پیوند با تبعیض و نژادپرستی بیاعتبار شد.

منتقدان هشدار میدهند که حتی پیشرفتهترین شبکههای عصبی نیز از دادههایی تغذیه میشوند که ممکن است حاوی سوگیریهای تاریخی باشند. اگر الگوریتمها بر پایه تصاویر گروههای خاصی آموزش دیده باشند، احتمال دارد بهطور ناخواسته همان نابرابریهای اجتماعی را بازتولید کنند.

نقش دادهها و زمینه اجتماعی

کیفیت عکس، نورپردازی، پسزمینه، دسترسی به عکاس حرفهای یا حتی هنجارهای فرهنگی درباره عکسهای رسمی، همگی میتوانند بر خروجی مدل تأثیر بگذارند. این در حالی است که عوامل تعیینکنندهای مانند فرصتهای آموزشی، شبکههای اجتماعی، شرایط اقتصادی و ساختارهای تبعیضآمیز در یک تصویر قابل مشاهده نیستند.

به همین دلیل، بسیاری از متخصصان اخلاق فناوری معتقدند اتکا به تحلیل چهره برای تصمیمهای استخدامی، بدون چارچوبهای شفاف و ممیزیهای مستمر سوگیری، میتواند خطرناک باشد.

ورود قانونگذاران

در برخی ایالتهای آمریکا، قانونگذاران مقررات سختگیرانهتری برای استفاده از فناوری تشخیص چهره در محیط کار وضع کردهاند. الزام به دریافت رضایت صریح متقاضیان و انجام ممیزیهای دورهای برای ارزیابی سوگیری الگوریتمی، از جمله اقداماتی است که برای کاهش ریسک تبعیض در نظر گرفته شده است.

آنچه زمانی به عنوان ابزار نوآورانه برای افزایش سرعت و «بیطرفی» در استخدام مطرح میشد، اکنون زیر ذرهبین نهادهای نظارتی و افکار عمومی قرار گرفته است.

پرسشهای بیپاسخ

با وجود پیشرفتهای چشمگیر در حوزه هوش مصنوعی، تردیدها همچنان پابرجاست:

آیا یک تصویر ثابت میتواند بازتابدهنده انگیزه، استعداد یا توان درآمدزایی یک فرد باشد؟

یا این فناوری، صرفاً نسخهای دیجیتال از همان قضاوتهای سطحی قدیمی است؟

در حالی که برخی شرکتها به کارآمدی و سرعت این ابزارها دل بستهاند، بسیاری از کارشناسان تأکید میکنند که تصمیمگیری درباره سرنوشت شغلی افراد بر اساس تحلیل یک عکس، بدون شفافیت و نظارت دقیق، میتواند پیامدهای اخلاقی و اجتماعی گستردهای به همراه داشته باشد.

انتهای پیام

افزودن دیدگاه جدید